Por Graziella Dell’Osa e Lucas Antzuk

Lições do Projeto Helene, uma parceria entre a Controladoria-Geral da União e Oracle no âmbito do programa Tech Connect for Integrity da OCDE

1. Introdução

Durante o evento Dia de Integridade Empresarial 2025, promovido pela Controladoria-Geral da União – CGU, foram anunciadas ao público as últimas atualizações sobre o Projeto Helene, desenvolvido em parceria entre a CGU e a Oracle (no âmbito do programa Tech Connect for Integrity da Organização para a Cooperação e Desenvolvimento Econômico – OCDE).

O projeto é um marco recente na aplicação de inteligência artificial (IA) para o combate à corrupção. Seu objetivo é identificar, de forma preditiva, fornecedores da Administração Pública com maior risco de sofrer sanções por irregularidades. Para isso, a CGU consolidou milhões de registros públicos — como contratos, cadastros de empresas, dados de sócios e histórico de preços — em um modelo de IA capaz de cruzar, analisar e criar parâmetros a partir dessas informações.

Os primeiros resultados são expressivos: em um teste realizado, “o modelo previu com sucesso alto risco de sanção para 611 das 624 empresas que foram posteriormente sancionadas oficialmente entre outubro de 2024 e fevereiro de 2025, demonstrando 97,9% de acurácia na identificação de entidades de risco”¹.

No entanto, os resultados positivos não vieram sem obstáculos. Foram relatados desafios com a qualidade dos dados, o equilíbrio das informações e a explicabilidade do modelo, aspectos essenciais para garantir a confiabilidade de qualquer solução baseada em IA. Da mesma forma, houve resultados que são falsos positivos, ou seja, empresas identificadas como alto risco pelo modelo, mas que não sofreram sanções. Para esses casos, não foi possível identificar critérios que justificassem a exclusão dos resultados.

As lições enfrentadas pelo poder público na implementação de um modelo de Inteligência Artificial que auxilie a avaliação de fornecedores dialogam diretamente com o setor privado. À medida que processos de due diligence e o compliance nas organizações incorporam tecnologias semelhantes, surgem riscos e responsabilidades que precisam ser tratados com governança e metodologia adequadas.

2. O Projeto Helene

O projeto Helene obteve taxas de acerto elevadas para um modelo que utilizou apenas informações públicas em sua base de dados. Porém, o maior diferencial não está apenas na precisão, mas em como o modelo foi desenvolvido.

Dados amplos e integrados

O projeto reuniu informações públicas e complementares, como histórico de contratos administrativos e perfis societários. A base de dados pública do Projeto Helene inclui as seguintes fontes:

- Portal da Transparência – dados de licitações e contratos (2003–2024).

- Registros de empresas – cadastro de empresas brasileiras.

- Estabelecimentos – registros de estabelecimentos comerciais no Brasil.

- Sócios – informações sobre sócios/acionistas e empresas associadas.

- Simples Nacional – regime tributário para empresas.

- CNAE – Classificação Nacional de Atividades Econômicas.

- Bolsa Família – base de beneficiários do programa social (utilizada como variável pública auxiliar no enriquecimento/cruzamento).

- CEIS – Cadastro de Empresas Inidôneas e Suspensas.

- CNEP – Cadastro Nacional de Empresas Punidas.

- CEPIM – Cadastro de Entidades Privadas Impedidas.

- CNPJs aptos – empresas aptas a participar de licitações (habilitadas).

Outras informações derivadas também são consideradas pelo modelo. Chamada de variáveis derivadas, a IA realiza a mineração da base de dados inicial que resulta em novas inferências, como o tempo de atividade, a intensidade de relacionamento com o setor público, a concentração regional, entre outras.

Modelo de decisão compreensível

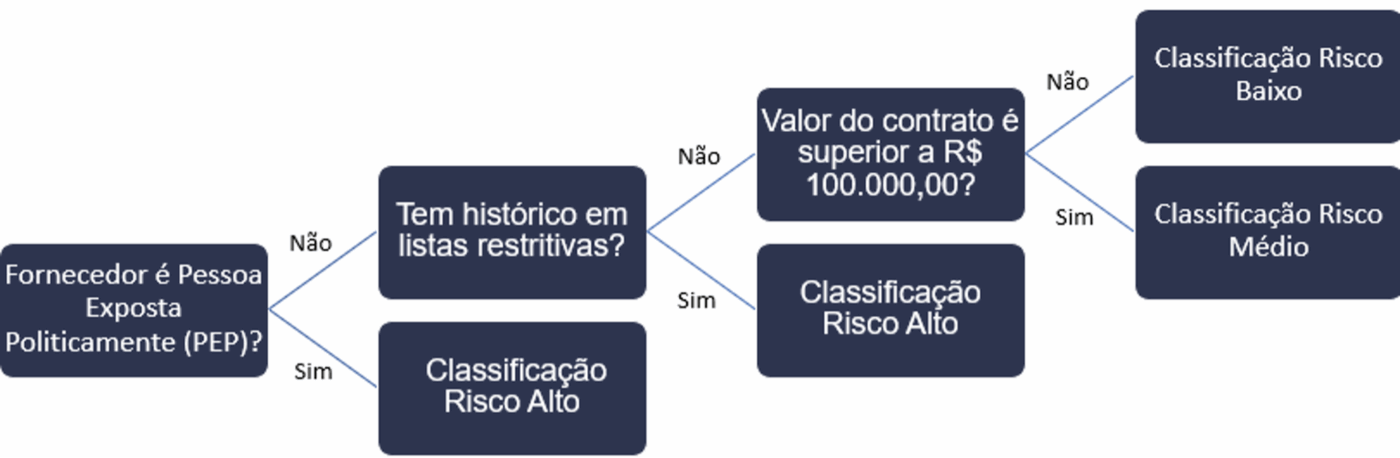

Um dos desafios enfrentados foi a escolha por qual modelo de algoritmo de classificação utilizar. Foram testados diferentes modelos e, ao final, em vez de algoritmos complexos de difícil interpretação, optou-se pelo modelo chamado de árvore de decisão, que permite ao humano identificar o fundamento de uma empresa ser classificada como de maior ou menor risco pelo modelo.

O modelo de árvore de decisão funciona como um fluxograma inteligente que a IA usa para chegar a uma conclusão. Ela avalia os dados de entrada e, a cada “nó” de decisão, faz perguntas do tipo “se/então” até chegar a uma classificação de risco ou recomendação.

Análise de novo fornecedor

Essa estrutura facilita a transparência e a explicabilidade, essenciais para a confiabilidade do modelo. Entretanto, para obter validade jurídica, o processo exige cuidados como definir uma metodologia sólida para evitar distorções e garantir validação humana para que os critérios estejam adequados a normas legais.

Validação rigorosa

A equipe enfrentou problemas como a predominância de empresas sem sanções (o chamado “desequilíbrio de classes”) e necessidade de tratar inconsistências, criando um processo robusto de revisão e teste.

Outra dificuldade enfrentada foi a existência de falsos positivos na lista de empresas classificadas como de alto risco. Ou seja, além das empresas que posteriormente se verificou a aplicação de sanções pela CGU, o teste realizado também classificou empresas que não vieram a sofrer sanções, sem que fosse possível verificar um critério para exclusão dessas empresas dos resultados positivos.

Apesar das medidas adotadas, o modelo está em constante processo de melhorias e depende diretamente de uma equipe qualificada para estruturar os parâmetros e analisar os resultados a fim de aprimorar o modelo.

Em outras palavras, o Projeto Helene mostra que bons resultados em IA não dependem apenas de tecnologia avançada, mas da capacidade de organizar dados de qualidade e explicar cada passo do processo — premissas igualmente cruciais para as empresas.

3. IA em processos de due diligence

O uso de IA em due diligence já é uma realidade, seja para avaliar terceiros, monitorar transações, identificar indícios de fraude ou para verificar situações complexas que não seriam verificáveis de outra maneira a um custo viável.

Porém, a experiência do Projeto Helene evidencia que a tecnologia, sozinha, não é suficiente. Há riscos concretos que devem ser analisados, como:

- Base de dados pouco robusta, inconsistente ou não qualificada, que pode gerar resultados distorcidos.

- Vieses estatísticos, quando a amostra analisada não reflete a realidade, levando a conclusões injustas.

- Decisões automáticas sem justificativa clara, incompatíveis com o nível de seriedade e precisão exigidos.

Para mitigar esses riscos, as empresas precisam não apenas de medidas tecnológicas, mas também de medidas de compliance e de governança para assegurar o correto e seguro uso da IA.

Medidas de Compliance

- Estabelecer nas políticas acerca do uso de IA a definição de papéis, responsabilidades e limites.

- Promover treinamento multidisciplinar, capacitando os colaboradores quanto ao uso ético e responsável da aplicação de IA, bem como as equipes técnicas, jurídicas e de compliance para análise e revisão das informações obtidas.

- Garantir respeito à legislação, especialmente a normas de privacidade e às regulamentações setoriais, assegurando que eventuais análises automatizadas possam ser revisadas e contestadas, quando aplicável..

Medidas de Governança

- Adotar metodologias de desenvolvimento e controle, como o CRISP-DM² ou o NIST AI Risk Management Framework³, que orientam todas as etapas do ciclo de vida do modelo (concepção, implementação e operação).

- Criar mecanismos de governança do uso de IA e monitoramento contínuo, com revisões, testes em todas as etapas do ciclo, testes periódicos e registro das decisões.

- Estabelecer regras que garantam auditabilidade, permitindo auditoria interna e externa dos resultados da IA.

- Implementar medidas corretivas em razão de desvios ou variações no desempenho.

Portanto, a IA aplicada em processos de due diligence de compliance precisa ser cercada por boas práticas técnicas e jurídicas, para que seus benefícios — velocidade, amplitude e precisão — não sejam ofuscados por riscos legais ou reputacionais.

As medidas adotadas no âmbito do Projeto Helene são um exemplo de boas práticas na implementação de ferramentas com uso de IA voltadas para a integridade. Nesse sentido, as medidas de compliance e de governança são fundamentais para garantir o funcionamento dessas ferramentas, trazendo possibilidade de verificação das informações e aceitação jurídica.

4. Perspectiva internacional

O movimento de aproximação entre tecnologia e integridade é global. Diversos países e organismos multilaterais já estabelecem padrões de governança para o uso de IA em contextos sensíveis:

- União Europeia: o AI Act, aprovado em 2024, exige que sistemas usados em áreas de alto impacto — como finanças e compliance — tenham documentação detalhada, transparência e supervisão humana.

- Estados Unidos: o NIST AI Risk Management Framework é hoje uma das principais referências para identificar e mitigar riscos no desenvolvimento de modelos.

Essas iniciativas apontam para um padrão comum: a IA pode ser decisiva no combate à corrupção, mas precisa de governança clara, revisões independentes e mecanismos de explicação acessíveis, seja em órgãos públicos ou nas corporações.

5. Conclusão

O Projeto Helene demonstra que a inteligência artificial é um recurso poderoso para fortalecer a integridade e antecipar riscos, mas também evidencia que só gera confiança quando sustentada por dados de qualidade, metodologia sólida e supervisão humana constante.

Uma questão é certa: este tema não é experimental, mas parte de um movimento regulatório global.

Para o setor privado, as lições são:

- Planejar a governança da IA antes de implantá-la em processos de due diligence ou monitoramento de riscos.

- Investir em capacitação multidisciplinar, permitindo que áreas jurídicas, de compliance e de tecnologia estejam alinhadas.

- Adotar frameworks reconhecidos e documentar decisões, assegurando explicabilidade e conformidade regulatória.

Ao seguir esse caminho, as empresas não apenas protegem seus negócios, mas também contribuem para um ambiente de mercado mais íntegro e competitivo, no qual a tecnologia serve ao interesse público e privado com responsabilidade e transparência.

Graziella Dell’Osa – Sócia Diretora do GCAA,

Lucas Antzuk – Advogado do GCAA

[1] OCDE – Tech Connect for Integrity – Projeto Helene, página 12 (disponível no link oecd.org/content/dam/oecd/en/networks/galvanizing-the-private-sector/tech-connect-for-integrity/OECD-Tech-Connect-for-Integrity-Oracle-CGU_PT.pdf).

[2] Cross Industry Standard Process for Data Mining.

[3] Artificial Intelligence Risk Management Framework, desenvolvido pelo NIST (National Institute of Standards and Technology, dos EUA).

#GCAA #gonsalesechoadvogados #TaeYoungCho #AlessandraGonsales #InteligenciaArtificial #CombateaCorrupcao #ProjetoHelene #CGU #OCDE #Compliance